Amazon Web Services (AWS) tok nylig imot TechCrunch til en eksklusiv omvisning i chip-laboratoriet der Trainium-brikkene utvikles — det samme laboratoriet som nå er kjernen i en serie milliardavtaler med noen av verdens mest innflytelsesrike AI-selskaper. Timingen var ikke tilfeldig: omvisningen fant sted kort tid etter at Amazon kunngjorde sin investering på 50 milliarder dollar i OpenAI, ifølge TechCrunch.

Hva er egentlig Trainium?

Trainium er Amazons egenutviklede AI-akseleratorbrikke, designet av Annapurna Labs og spesialbygd for storskala maskinlæringsopplæring. Mens Nvidias H100-GPUer har vært bransjestandarden for AI-trening, posisjonerer AWS Trainium seg som et billigere og mer skalerbart alternativ — særlig for selskaper som kjører store arbeidsbelastninger over lang tid.

Anthropic: Fra startinvestering til dyptgående samarbeid

Amazon har totalt investert 8 milliarder dollar i Anthropic — 4 milliarder i første omgang, deretter ytterligere 4 milliarder. Investeringen har ikke bare gitt Anthropic kapital, men også forankret AWS som selskapets primære skytjeneste- og treningspartner.

Anthropic har inngått et teknisk samarbeid der ingeniørene jobber direkte med Annapurna Labs for å optimalisere fremtidige generasjoner av Trainium-brikker. De bidrar også til utviklingen av AWS Neuron-programvarestakken, noe som gir dem tilgang til optimaliseringer helt ned på silisium-nivå, ifølge TechCrunch-rapporten.

Sentral i samarbeidet er «Project Rainier» — en enorm beregningsklynge bestående av hundretusenvis av Trainium2-brikker, dedikert til å trene Anthropics fremtidige Claude-modeller.

Det er verdt å merke seg at Anthropic parallelt har forpliktet seg til å bruke opptil én million Google Cloud TPU-er, noe som viser at selskapet opererer med en multi-sky-strategi på tross av det tette AWS-forholdet.

OpenAI: 2 gigawatt og et brudd med gamle vaner

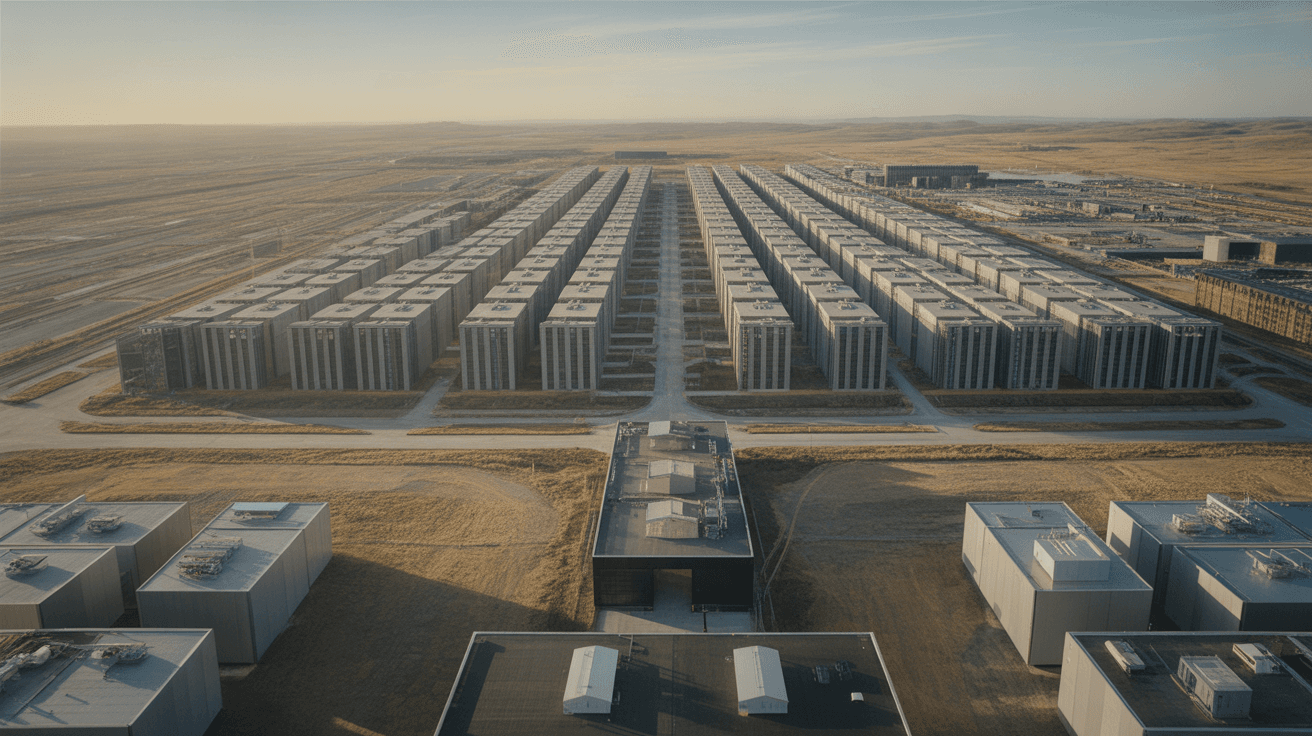

OpenAIs deltakelse i Trainium-økosystemet representerer et markant strategiskifte. Selskapet har forpliktet seg til å konsumere rundt 2 gigawatt Trainium-kapasitet gjennom AWS-infrastrukturen, fordelt på både nåværende Trainium3-brikker og kommende Trainium4-generasjon.

Målet er en prisytelseforbedring på 40 prosent for høyvolum-inferensoppgaver som ChatGPT, sammenlignet med eksisterende løsninger, ifølge TechCrunch. AWS skal i tillegg fungere som eksklusiv tredjeparts skydistributør for OpenAI Frontier — selskapets bedriftsrettede agentplattform.

OpenAI begrunner dette med en bevisst «multi-vendor»-strategi: å spre infrastrukturrisiko og redusere avhengigheten av Nvidia og det som internt omtales som «Nvidia-skatten» — en premie selskaper betaler for H100-kapasitet under press.

Apple: Over 40 prosent effektivitetsgevinst

Apple er kanskje den mest overraskende aktøren i Trainium-historien. Selskapet har brukt AWS i over ti år for tjenester som Siri, Apple Maps og Apple Music, men avslørte nylig at det aktivt bruker AWS-brikker til å trene AI-modellene som driver Apple Intelligence.

Ved å bytte til AWS Graviton og Inferentia-brikker fra tradisjonelle x86-instanser, har Apple oppnådd mer enn 40 prosent effektivitetsgevinst for maskinlæringsarbeidsbelastninger, ifølge TechCrunch-kildematerialet. Tidlige tester av Trainium 2 indikerer potensielle forbedringer på opptil 50 prosent i modelltrening-effektivitet.

Apple understreker at bruken av AWS-brikker utelukkende gjelder treningsfasen. Selve AI-prosesseringen på brukerenheter foregår fortsatt innenfor Apples eget Private Cloud Compute-rammeverk — i tråd med selskapets personvernlinje.

En ny konkurransefront mot Nvidia

Den samlede interessen fra Anthropic, OpenAI og Apple signaliserer at AWS Trainium er i ferd med å etablere seg som et reelt alternativ til Nvidias dominerende posisjon i AI-infrastrukturmarkedet. Kostnadsnivå, skalerbarhet og tett integrasjon med AWS sitt skyøkosystem trekkes frem som de viktigste driverne.

Om Trainium faktisk leverer på de oppgitte ytelseslovnadene i produksjonsskala — og ikke bare i kontrollerte testmiljøer — gjenstår å se. Men signalene fra tre av verdens tyngste AI-aktører er tydelige nok til at Nvidias ledelse bør merke seg bevegelsen.